Gyilkosság-előrejelző programot fejlesztettek az Egyesült Királyságban.

Nem mondunk újat azzal, hogy az AI már jelenleg is sok mindenre használható, és a jövőben vélhetően egyre több területen jelenik majd meg. A technológiát többek közt a bűnüldözésben is használják, bár ez egyelőre egy nagyon vitatott és érzékeny téma, többek közt az arcfelismerő technológia miatt is, ami a diktatórikus megfigyelések alapja is lehet - egyes országokban az arcfelismerést tömeges megfigyelésre és elnyomásra használják. Az Egyesült Királyság kormánya most egy olyan programmal állt elő, amely a gyilkosságok előrejelzésében segíthet, ám ahogy sok AI-módszer, ez is számos etikai kérdést felvet.

A szóban forgó mesterséges intelligenciát emberek ezreinek adataival képezték ki, a cél pedig az, hogy bizonyos minták mentén be tudják azonosítani, hogy a nyilvántartásban lévő emberek közül melyek azok, akiknél fennáll a veszélye, hogy súlyos bűncselekményt követhetnek el a jövőben - írja a The Guardian. A rendszert eredetileg „gyilkosság előrejelző projektnek” hívták, később változott a neve, az Igazságügyi Minisztérium mindenesetre reméli, hogy a projekt hozzájárul a közbiztonság fokozásához és a súlyos bűncselekmények csökkentéséhez. Mások ezzel szemben inkább „dermesztőnek és disztópikusnak” nevezik a projektet.

A Statewatch nevű jogvédő csoport például aggodalmát fejezte ki azzal kapcsolatban, hogy a kormány érzékeny személyes adatokat használhat fel, beleértve olyan személyek adatait is, akiknek nincs bűnügyi előéletük, de például családon belüli erőszak áldozatai vagy mentális egészségi problémákkal küzdenek. A minisztérium ugyanakkor határozottan cáfolja ezt, azt állítva, hogy csak és kizárólag olyan személyek adataival dolgoznak, akik esetében már fennáll a büntetett előélet - ennek némiképpen ellentmond, hogy saját elmondásuk szerint is felhasználják az áldozatok és tanúk adatait is. Bár a kormány szerint a projekt jelenleg csak kutatási célokat szolgál, a Statewatch véleménye szerint a technológia azért is problémás, mert az ilyen előrejelző algoritmusok megerősíthetik az egyébként is jelen lévő rendszerszintű előítéleteket, különösen az etnikai kisebbségek és alacsony jövedelműek esetében.

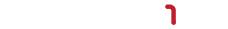

Felmerül továbbá, hogy mennyire lehet etikus egy olyan technológia használata, amely „veszélyesnek” minősíthet valakit anélkül, hogy az bármit elkövetett volna - másrészről a technológia életeket menthet, ha a segítségével időben észrevesznek egy eszkalálódó helyzetet, és a hatóság nem csak a bűncselekmény után lép. A kérdés tehát közel sem fekete vagy fehér, a Tom Cruise főszereplésével készült Különvélemény pedig már évekkel ezelőtt eljátszott ezzel a gondolattal – a különbség az, hogy ez mostanra már nem csak puszta fikció.

Borítókép forrása: 20th Century Fox